Der Angriff auf Südwestfalen-IT durch die Ransomware-Gruppe „Akira“ im Oktober 2023 bietet wertvolle Einsichten in Cybersicherheitsrisiken und Präventionsstrategien. Dieser Blogbeitrag analysiert die einzelnen Schritte der Angreifer und diskutiert, wie diese hätten vermieden werden können. Als Quelle fungierte der öffentliche forensische Bericht.

Schritt 1: Identitäten absichern und Sicherheitsupdates einspielen

Schwachstelle in der VPN-Lösung: Der Angriff begann mit dem Ausnutzen einer Schwachstelle (CVE-2023-20269) in der VPN-Lösung ohne Multi-Faktor-Authentifizierung (MFA).

Warum Kennwörter unsicher sind und selbst MFA nicht immer ausreichend ist!

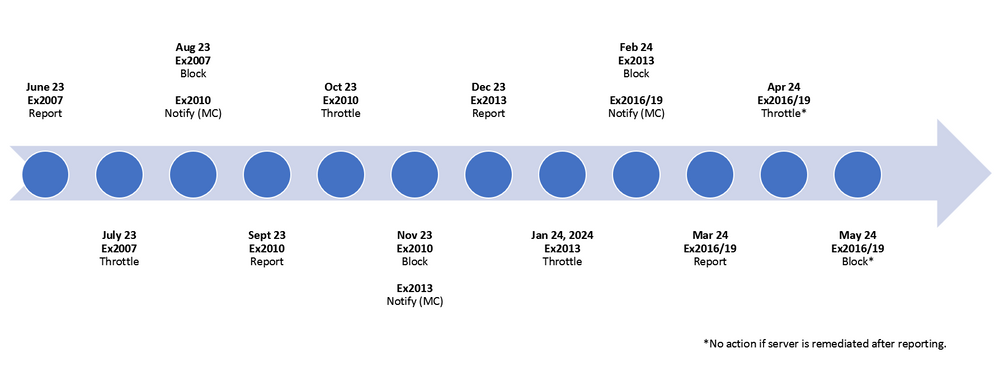

Die angebliche Zero-Day Schwachstelle, welche von der Akira Ransomware Gruppe ausgenutzt wurde, wurde bereits am 24ten August von Cisco in einem Blog Artikel erwähnt. Von einer Zero-Day Attacke (CVE-2023-20269) kann bei 55 Tagen nach Bekanntgabe daher nun wirklich keine Rede sein. Ein passendes Sicherheits-Update wurde am 11ten September zur Verfügung gestellt. Erste identifizierte Angriffe wurden am 18ten Oktober identifiziert werden.

Akira Ransomware Targeting VPNs without Multi-Factor Authentication – Cisco Blogs

Prävention: Die Implementierung von einer sicheren MFA hätte den Zugriff deutlich erschwert. Außerdem sollte bei Bekanntgabe von CVE’s immer eine direkte Bewertung sowie passende Maßnahmen umgesetzt werden. Die Einrichtung von Systemen zur Erkennung verdächtiger Aktivitäten, wie ungewöhnliche Anmeldeversuche oder auffällige Netzwerkbewegungen, hätte die frühzeitige Erkennung des Angriffs ermöglichen können.

Schritt 2: Ausbreitung

Erhalten administrativer Berechtigungen: Nach dem Zugang zum Netzwerk erlangten die Angreifer administrative Rechte.

Die Angreifer konnten das Administrator-Kennwort ausnutzen, weil es seit 2014 in einem Gruppenrichtlinienobjekt in entschlüsselbarer Textform hinterlegt war. Jeder Angreifer mit gültigen Domänen-Zugangsdaten konnte dadurch das Kennwort auslesen. Unter Verwendung eines von Microsoft bereitgestellten AES-Schlüssels ließ sich das Kennwort entschlüsseln, was den Angreifern ermöglichte, ihre Zugriffsberechtigungen auf das Niveau eines Domänen-Administrators zu erhöhen, ohne dabei typische forensische Anzeichen für Privilege Escalation oder Lateral Movement zu hinterlassen.

Prävention: Striktere Zugriffskontrollen und regelmäßige Überprüfungen der Berechtigungen hätten dies verhindern können. Sie sollten regelmäßig ihre Identity und Access Management Systeme auditieren.

Schritt 3: Verbreitung der Ransomware

Verbreitung der Ransomware: Die Ransomware wurde innerhalb der Windows-Domäne verbreitet. Die Verteilung der Ransomware erfolgte gezielt und anscheinend mittels Zugriffen auf das C$-Netzwerkshare der einzelnen Server. Es wurde angenommen, dass die Ransomware von Zielsystemen durch diese Zugriffe ausgeführt wurde. Diese Annahme stützt sich darauf, dass keine Spuren gefunden wurden, die auf andere Verteilungsmethoden hindeuten. Außerdem wurde festgestellt, dass die Ransomware w.exe selbst Logfiles schrieb, welche dokumentierten, welche Aktionen durch die Schadsoftware durchgeführt wurden und welche Fehler beim Verschlüsseln auftraten.

Es wurden 961 Systeme identifiziert, auf denen die Ransomnote akira_readme.txt vorzufinden war. Zum Glück wurden keine GPO’s, wie bei anderen Ransomware Gruppen üblich, verwendet. Andernfalls wären ca. 4200 Clients und 800 Server betroffen.

Prävention: Bessere Netzwerksegmentierung, ein AD Tiering, eine klassische Server Härtung und strengere Zugangskontrollen hätten die Ausbreitung eingedämmt.

AD Tiering Struktur – Funktion und Nutzen

Schritt 4: Verschlüsselung von Daten

Die Ransomware verschlüsselte das Dateisystem von Südwestfalen-IT, indem sie einen rekursiven Ansatz verfolgte. Das Programm durchlief das gesamte Dateisystem und verschlüsselte jedes Verzeichnis einzeln, beginnend mit dem angegebenen Startpfad. Interessanterweise nutzte die Ransomware, benannt als w.exe, eine Blacklist, um bestimmte Dateitypen, Dateiendungen und Verzeichnisse von der Verschlüsselung auszunehmen. Nachdem die Verschlüsselung in einem Verzeichnis abgeschlossen war, platzierte die Ransomware in jedem betroffenen Verzeichnis eine Erpressungsnachricht mit dem Namen „akira_readme.txt“

Prävention: Regelmäßige Backups und ein effektiver und regelmäßig erprobter Disaster-Recovery-Plan hätte zudem eine schnellere Wiederherstellung der Systeme ermöglicht.

Schlussfolgerung:

Das Fazit aus dem Angriff auf Südwestfalen-IT durch die Ransomware-Gruppe „Akira“ unterstreicht die Wichtigkeit einer umfassenden und proaktiven Cybersicherheitsstrategie. Die Schlüsselerkenntnisse sind:

- Bedeutung von Multi-Faktor-Authentifizierung: Die Abwesenheit von MFA, insbesondere bei kritischen Zugangspunkten wie VPNs, kann Türöffner für Cyberangriffe sein. MFA ist ein wesentlicher Bestandteil zur Verstärkung der Sicherheitsmaßnahmen.

- Wichtigkeit regelmäßiger Sicherheitsaudits: Die Identifizierung und Behebung von Schwachstellen, wie z.B. schlecht gesicherte Passwörter, ist entscheidend, um potenzielle Angriffsvektoren zu minimieren.

- Notwendigkeit von Netzwerksegmentierung und strengen Zugriffskontrollen: Diese Maßnahmen können die Bewegungsfreiheit von Angreifern im Netzwerk begrenzen und die Ausbreitung von Malware verhindern oder zumindest einschränken.

- Proaktive Überwachung und Anomalie-Erkennung: Frühzeitige Erkennung von verdächtigen Aktivitäten und Angriffsversuchen ist entscheidend, um Eindringlinge abzuwehren, bevor sie ernsthaften Schaden anrichten können.

- Bewusstsein und Schulung der Mitarbeiter: Da Menschen oft das schwächste Glied in der Sicherheitskette sind, ist es wichtig, das Bewusstsein und die Wachsamkeit der Mitarbeiter zu stärken.

- Robuste Backup- und Disaster-Recovery-Strategien: Diese sind unerlässlich, um die Resilienz gegen Ransomware-Angriffe zu erhöhen und die Geschäftskontinuität im Falle eines Datenverlusts sicherzustellen.

- Einsatz fortschrittlicher Sicherheitslösungen: Der Einsatz moderner Antivirus- und Endpunkt-Schutzlösungen kann dazu beitragen, Bedrohungen frühzeitig zu erkennen und zu neutralisieren.

Der Vorfall zeigt einmal mehr, dass Cybersicherheit ein kontinuierlicher Prozess ist, der ständige Aufmerksamkeit und Anpassung erfordert, um mit den sich ständig weiterentwickelnden Bedrohungen Schritt zu halten.

Abschließend lässt sich sagen, dass der Angriff auf Südwestfalen-IT die Notwendigkeit eines Zero-Trust-Ansatzes in der Cybersicherheit unterstreicht. Zero-Trust bedeutet, grundsätzlich keinem Akteur innerhalb oder außerhalb des Netzwerks zu vertrauen, sondern jede Anfrage als potenzielle Bedrohung zu behandeln. Dieser Ansatz fordert eine kontinuierliche Überprüfung und Authentifizierung, um Sicherheit in einer immer komplexeren und vernetzteren digitalen Welt zu gewährleisten. Der Vorfall zeigt deutlich, dass der Übergang zu einem Zero-Trust-Modell für Unternehmen unerlässlich ist, um sich gegen fortgeschrittene und sich ständig weiterentwickelnde Cyberbedrohungen zu schützen.